Justice e fairness: compreendendo dois princípios da ética de IA

A importância de desfazer a confusão entre os conceitos das declarações de princípios éticos de IA

Com o surgimento de várias declarações que consolidaram princípios éticos para a inteligência artificial, hoje temos um conjunto robusto desses princípios. Na sequência, muitos deles foram colocados nos textos dos projetos de leis que visam regular a tecnologia, como o AI Act e o PL 2338/2023. É a fase na qual nos encontramos.

Mas isso não quer dizer que não exista certa confusão em relação ao sentido de determinados princípios encontrados nos diversos documentos. É o que acontece com os termos justice e fairness.

A justiça aparece, por exemplo, nos Princípios Asilomar que incluem a necessidade tanto de “benefício partilhado” como de “ prosperidade compartilhada” da IA. O Statement on Artificial Intelligence, Robotics and Autonomous Systems da Comissão europeia defende que a IA deve “contribuir para a justiça global e a igualdade de acesso aos benefícios” dessa tecnologia.

Assim, aparece nos documentos uma preocupação social com uma distribuição adequada dos benefícios da IA que é expressa em termos de justiça.

Mas também encontramos nos documentos o uso da palavra fairness, relacionada ao risco de vieses discriminatórios pelo uso da IA, o que se encontra diretamente ligado às questões da diversidade e da não discriminação. O Statement da Comissão europeia, por exemplo, também alerta contra o risco de parcialidade nos conjuntos de dados (datasets) utilizados para treinar sistemas de IA.

Os conceitos estão, é claro, relacionados: a não discriminação, que se materializa em medidas para que os datasets representem adequadamente as populações que são atingidas por decisões de sistemas de IA — sem favorecer mais uma categoria de pessoas que outra (daí o termo fair) — leva a uma sociedade mais justa.

Mas os documentos utilizam tanto fairness quanto justice, como no caso dos princípios de IA da OCDE.

“Os desenvolvedores de IA devem respeitar o Estado de Direito, os direitos humanos e os valores democráticos, ao longo de todo o ciclo de vida do sistema. Dentre eles estão a liberdade, a dignidade e a autonomia, a privacidade e a proteção de dados, a não discriminação e a igualdade, a diversidade, a equidade (fairness), a justiça (justice) social e os direitos laborais internacionalmente reconhecidos”.

Segundo Floridi e Cowls, as diversas maneiras pelas quais a justiça é caracterizada — como justice e como fairness — sugerem uma falta mais ampla de clareza dos documentos sobre o papel da IA para o ser humano.

Penso que um primeiro passo para pensar nisso, é fazer a distinção entre esses dois conceitos. Justice é algo mais fácil de compreendermos. Resta falarmos mais detalhadamente de fairness.

A tradução de fairness para o português é problemática, não há uma correspondência direta com alguma palavra da nossa língua. Se você colocar a palavra no Google Translator, a tradução que vai aparecer é justiça. Mas então como traduziríamos para o português o título da obra-prima de John Rawls, Justice as Fairness? Justiça como justiça? Não faz sentido, não é?

O termo fair, do qual deriva fairness, significa tratar todos os lados igualmente, de forma justa, equitativamente; a mesma ideia traz a palavra impartial: não favorecer mais um lado do que outro.

No Brasil, escolheu-se o termo equidade para traduzir a palavra do título da obra de Rawls, que ficou, então, Justiça como Equidade.

A palavra equidade tem uma longa história na ética e no direito. Aristóteles considera a equidade como um corretivo para o que é justo conforme a lei. Mas a palavra fairness, que costumamos traduzir como equidade, tem na cultura anglo-saxônica outro sentido: ela remete a uma situação de imparcialidade, igualdade. Na teoria de Rawls, por exemplo, fairness (equidade) significa uma situação na qual nenhum participante do acordo inicial que estabelece os princípios de justiça se encontra em uma condição superior, em relação a seus pares, que lhe possibilite estabelecer princípios benéficos apenas a ele.

Na ética de IA, o uso da palavra fairness carrega naturalmente esse significado, aparecendo muito ligado às preocupações com a diversidade e com a não discriminação, como no trecho abaixo do Ethics Guidelines da União Europeia:

“Os vieses injustos devem ser evitados, pois podem ter múltiplas implicações negativas, desde a marginalização de grupos vulneráveis até à exacerbação do preconceito e da discriminação. Ao promover a diversidade, os sistemas de IA devem ser acessíveis a todos, independentemente de qualquer deficiência, e envolver as partes interessadas relevantes ao longo de todo o seu ciclo de vida”.

As preocupações de autoras como Joy Buolamwini e Timnit Gebru em relação sistemas de reconhecimento facial que apresentam viés de gênero ou racial se inserem aqui. Assim, o risco de parcialidade nos conjuntos de dados utilizados para treinar sistemas de IA deve ser combatido.

As preocupações da Lei 144 da Cidade de Nova York que visa combater o viés racial em sistemas de contratação de pessoal também se encaixam em preocupações de fairness.

Por fim, o Ethics Guidelines for Trustworthy Artificial Intelligence da União Europeia ainda distingue duas dimensões do conceito de fairness.

Dimensão substantiva: “implica um compromisso para garantir uma distribuição igual e justa de benefícios e custos e garantir que os indivíduos e grupos estejam livres de vieses injustos, discriminação e estigmatização. Se for possível evitar vieses injustos, os sistemas de IA poderão até aumentar a equidade (fairness) social. A igualdade de oportunidades em termos de acesso à educação, bens, serviços e tecnologia também deve ser promovida. Além disso, a utilização de sistemas de IA nunca deve levar as pessoas a serem enganadas ou prejudicadas injustificadamente na sua liberdade de escolha. Além disso, a equidade implica que os profissionais de IA devem respeitar o princípio da proporcionalidade entre meios e fins, e considerar cuidadosamente como equilibrar interesses e objetivos concorrentes”.

Dimensão processual: “implica a capacidade de contestar e procurar reparação eficaz contra decisões tomadas por sistemas de IA e pelos humanos que os operam. Para o fazer, a entidade responsável pela decisão deve ser identificável e os processos de tomada de decisão devem ser explicáveis”.

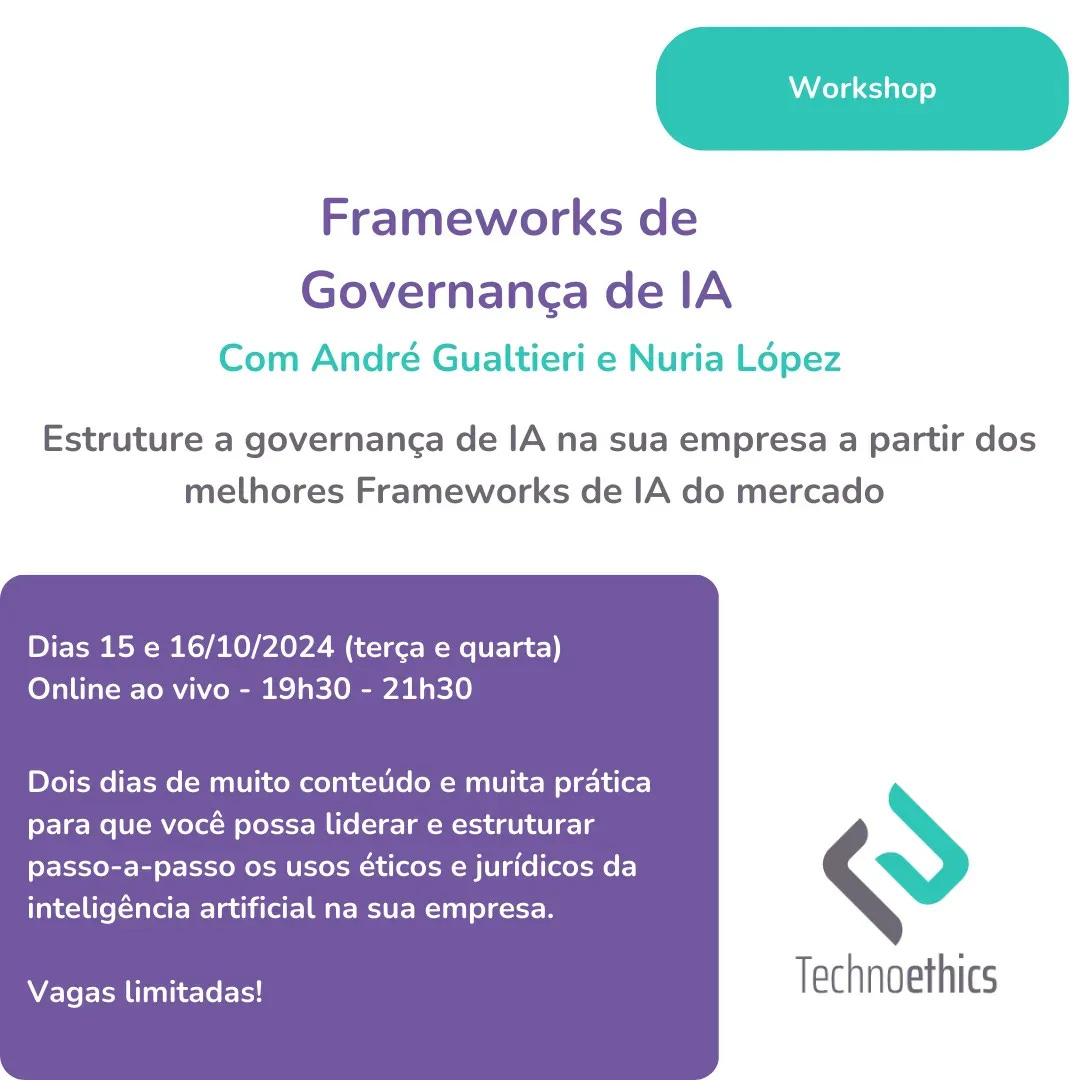

WORKSHOP FRAMEWORKS DE GOVERNANÇA DE IA [ÚLTIMA EDIÇÃO DE 2024]

Dias 15 e 16/10/2024 (3ª e 4ª feira), das 19h30 às 21h30, André Gualtieri e Nuria López vão estar online e ao vivo em um workshop exclusivo que vai apresentar quatro dos principais Frameworks de IA do mercado (UE, ICO, NIST e OCDE).

Serão dois dias de muito conteúdo aprofundado e prático sobre como esses Frameworks podem ajudar você a construir a Governança de IA na sua empresa.

As vagas são limitadas, então clique aqui para se inscrever já.

Excelente texto, professor! É um tema que, para quem estuda o "ramo" precisa dar um foco considerável, pois não é questão mais de futuro, mas sim de presente. São discussões para agora. Agradeço pelo cuidado de trazer os termos em inglês e também adaptá-los para o português.